本文系作者原创,授权“美国华人杂谈”独家发布。

过去十余天的时间里,以色列和伊朗之间的冲突不仅吸引了全世界的目光,更把一度声称秉承孤立主义的川普,也拉进了战局。

结果,就在昨天大家以为冲突将在美国轰炸伊朗核设施后,进一步升级时,川普却又来了个180度大转弯,以第三方的身份宣布了两国停火,让人大跌眼镜。

截至今天发稿前以-伊双方算是暂时进入了脆弱的停火期,是否还会重燃战火仍有待观察。

这次冲突的一个显著特点是有大量以影像方式出现的虚假信息,特别是AI生成的内容,在社交媒体上广为传播。而首发和转发这些信息的既有普通账号,也有来自冲突双方的官方身影。

特别是双方官方或媒体账号的推波助澜,让本就脆弱的信息生态变得更加混乱,让用户不知道应该信谁。

今天的文章,我们就通过一组典型的虚假影像,来告诉你如何辨别这些AI时代的假消息。因为这些信息,很可能在将来的突发事件中成为常态。

AI生成影像获得大量流量

相信关心伊以冲突的朋友们可能都在群里见到过这张题图——一架被击毁的美军第五代战机F-35。

有人说这是伊朗击落以色列的军机,但仔细甄别能看出,这实际是一张AI生成的假图。对比下面这张F-35的官方外观图可以看出,坠毁图的尾翼是反向安装的,而且坠毁的飞机发动机也不可能还在点燃的状态。

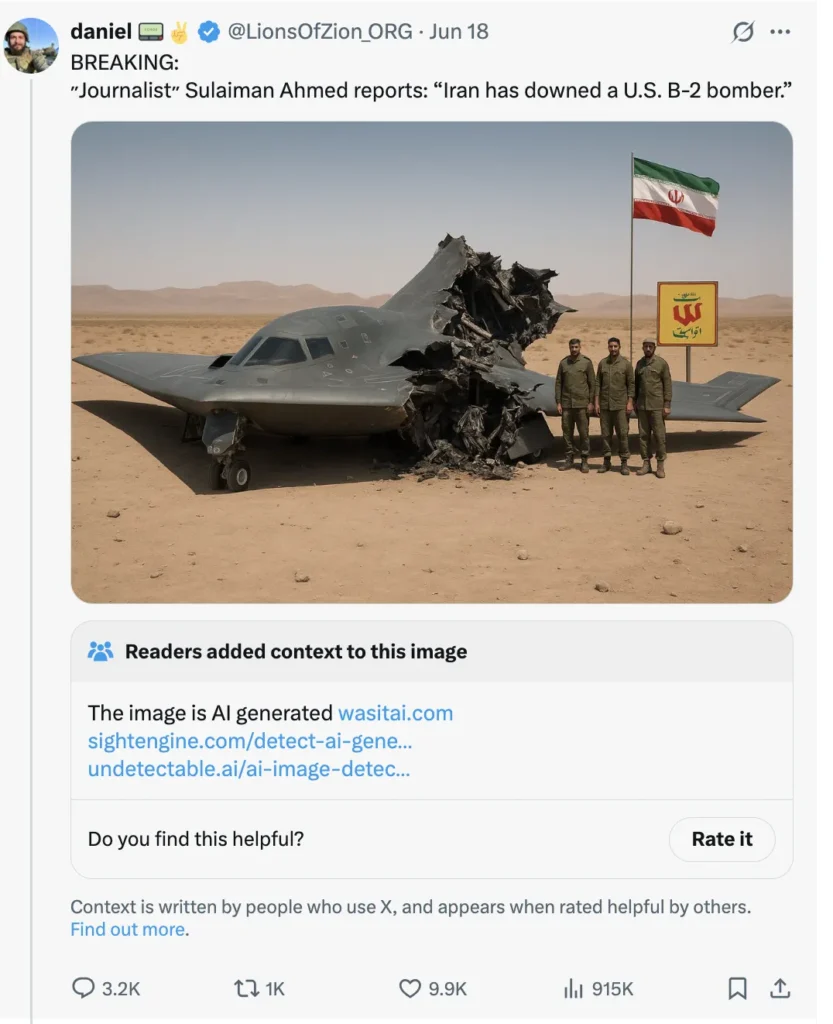

类似的AI生成内容还有不少,BBC对另一张在社交媒体上广为传播的图片进行了验证,也发现了一些让人啼笑皆非的造假证据。

类似的AI生成内容还有不少,BBC对另一张在社交媒体上广为传播的图片进行了验证,也发现了一些让人啼笑皆非的造假证据。

在下面这张“吃瓜群众围观坠毁的B2轰炸机”图片中,一个最明显的错误就是左下角人和车辆、人和建筑的比例严重失调。这也是一个仔细观察就能轻易发现的假图证据。

类似的,像下图这样“一眼假”的AI图,也在这次冲突过程中大量传播。

除了AI生成的图片,还有一些AI生成的短视频更加吸引眼球,也更难以分辨。

比如下面这段短视频,呈现了一次疑似核爆的现场,推文的文字部分也说,6月22日凌晨4点左右,伊朗被炸了,核战争开始了。

然而,事实核查机构POLITIFact却发现,这段视频其实来自于一个名叫@cmlacyn的YouTube频道。该频道的介绍明确写了,“该频道的所有视频都是AI制作的”。但在X平台上发布这段视频的账号“Ukraine Front Line”却并未注明该关键信息。

类似的还有以下这段《德黑兰时报》发布的视频,该账号声称这段视频是被炸毁的以色列城市特拉维夫。但X的社区记录显示,该视频为5月27日发布在TikTok上的一段AI生成的视频。

虚假信息分析组织Get Real的首席调查官艾玛努尔·萨利巴(Emmanuelle Saliba)在接受BBC采访时说,这场信息洪流“是我们第一次看到生成式人工智能在冲突中被大规模使用”。

各类视频被冠以以-伊冲突之名 混淆视听

除了这一批AI生成的内容,一些过去发生的或在其他地区发生事件的影像,也被动地卷入了这次冲突,被当作是与该事件有关的视频在X平台上流传。

下面这一段一群伊朗人在一个隧道中跳舞的视频就被描述为伊朗人公开庆祝以色列的袭击,以表达对现状的不满。

然而,来自Euronews的记者使用Google反向搜索该视频的截图后发现,这一段影像早在2023年就已经存在了。

不少亲以色列的账号发布了类似的内容,错误地声称这些视频反映出伊朗民众对政府的不满,以及对以色列军事行动的支持。

另一个Facebook上的账号用缅甸语写道:“伊朗的第五次袭击摧毁了以色列的主要军事基地。”帖子还分享了一段浏览量超过 2.5 万次的视频,视频显示人们正在逃离广场附近的大火。

然而,这段视频却是来自中国的重庆,右图就是该视频在小红书上的帖子,实际情况是重庆的一排电动自行车在高温下起火。

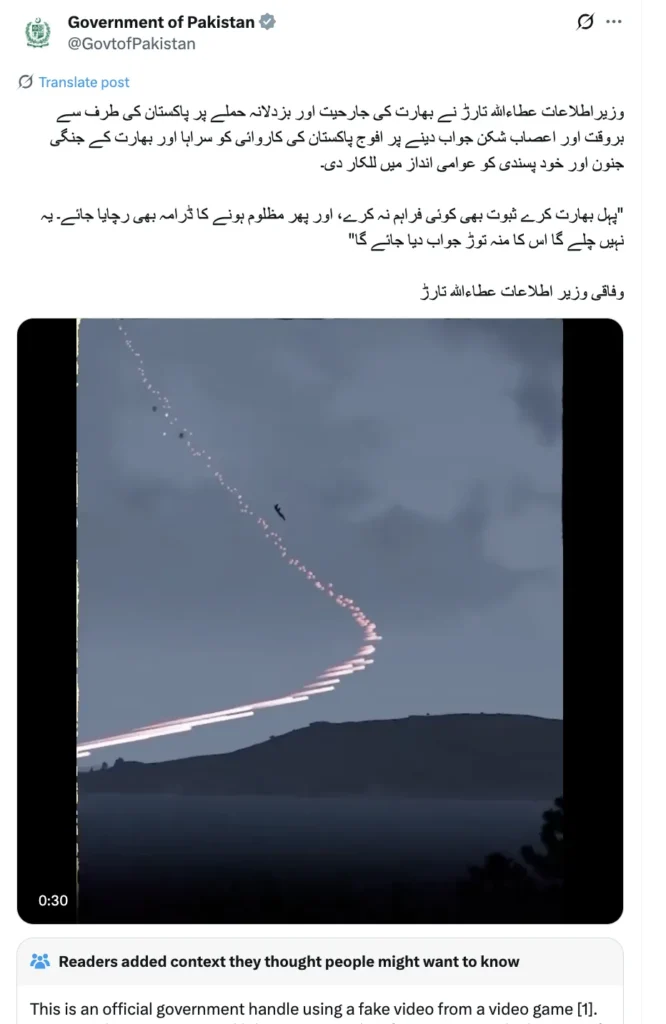

除了将发生在过去的或是其他地区的视频说成和以色列、伊朗冲突有关,还有的社交媒体账号直接用上了空战游戏里的画面。

发布该视频的用户声称,这是要前往伊朗的B2轰炸机正要从加州起飞。然而,这段视频搬运了5月15日发布在TikTok上的另一段视频。在TikTok上,发布人注明了这是一款微软制作的飞行模拟游戏。

而下图中的这段十年以前的游戏视频,不仅出现在了这次以-伊冲突中,就连上个月印度和巴基斯坦的军事冲突发生后,也被巴基斯坦政府的官方账号发出来,声称击落了印度的战机。然而,实际上,这段视频出自一款2013年上市,名叫《Arma3》的游戏。

为何如此多的社交媒体账号热衷于在这场引发全球关注的军事冲突中,大肆传播虚假信息呢?

首当其中就是发现了其中的流量密码。

BBC就发现,下面这个亲伊朗的社交媒体账号在发生冲突以来异常活跃,每天都发布大量亲伊朗的相关信息,其中也充斥着不少虚假信息。凭借频繁发帖,该账号的关注者从6月14日,冲突发生时的70万人,飙升到昨天的170万人,整整涨粉了100万。

其次,在军事冲突、政治选举之类二元对立的事件中,双方都希望制造有利于己方的舆论氛围。于是,一些人就选择了使用成本低廉的AI生成影像,来达到宣传己方功绩,放大对手失败的目的。

未来随着AI技术的进一步发展,其生成图片和视频的质量必然会进一步增加,因此,也会有更多人利用这些工具来制造虚假信息,来追求经济或政治目的。我们应对如何识别呢?

对于图片而言,目前AI生成的图片,尤其是还原复杂的新闻现场还难以做到以假乱真,像前文提到的飞机坠毁图片,只要细心观察,就很容易发现问题。

而对于视频而言,加州大学伯克利分校专门研究数字取证的教授哈尼·法里德(Hany Farid)指出,许多人工智能生成的视频通常只有八秒或更短,或者由八秒钟的片段剪辑而成。这是因为谷歌的 “Veo 3″(一种文本到视频的生成工具)有八秒钟的限制。因此,如果一段短视频只有八秒或以下,或许就很有可能是由AI生成的影像。

此外,关注消息源也是避免被虚假信息误导的另一个重要方法,尤其需要提高警惕的是一些伪装成官方账号的内容发布者,和以独立信息提供者自居,但实际却常有传播虚假信息劣迹的账号。

最后,在看到来源不明的信息时,可以使用图片搜索等工作进行反向核实,在确认真实性之前不要转发,也能避免虚假信息的进一步传播。